思维链CoT再遭质疑! 三大证据实锤, 真正可泛化推理还很远?

思维链(CoT)提示技术已被证明能提升大语言模型(LLM)在各类任务中的表现。采用该方法时,LLM似乎会先生成类似人类的推理步骤(即CoT推理),再给出最终答案,这往往让人觉得LLM正在进行深思熟虑的推理过程。

然而,亚利桑那州立大学团队在一项新研究中指出:CoT推理实为脆弱的幻象,一旦超出训练分布范围便会失效。

换句话说,CoT推理的有效性并非源于模型的逻辑推演能力,而是对训练数据模式的记忆与插值,其本质是高度结构化的模式匹配,而非真正可泛化的逻辑推理。

这一结论引发了人工智能(AI)行业从业者对CoT本质的重新审视。

论文链接:https://arxiv.org/abs/2508.01191

研究团队表示,这项工作深化了人们对CoT推理失效原因与条件的理解,凸显了实现真正可泛化推理仍是持续面临的挑战。

从何质疑?

越来越多的研究表明,LLM往往依赖于表面语义和线索,而非逻辑推理过程。

为此,他们通过提出数据分布的替代视角来质疑CoT推理,并进一步探究其失效的原因与时机。他们通过任务(task)、长度(length)和格式(format)三个维度对CoT推理进行了剖析。

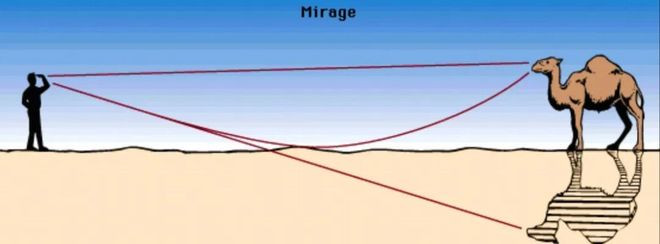

图|数据分布视角。CoT推理的有效性从根本上受限于训练数据与测试查询之间的分布差异程度。

1.任务泛化

任务泛化能力是CoT推理面临的核心挑战,它直接检验模型将学到的概念与推理模式应用于未知场景的能力。

任务泛化测试聚焦模型对“新任务新结构”的适应能力,包括变换泛化(TransformationGeneralization)和元素泛化(ElementGeneralization)两个维度。

1)变换泛化

在变换泛化实验中,研究人员设计了四种分布偏移场景,从“ID”到“OOD”,逐步升级:

表|不同场景下变换泛化能力的全链路评估。

另外,如下表,从f1∘f2到f2∘f2,LLM能够正确回答0.1%的问题。但进一步检查发现,这只是一个巧合,如查询元素为A,N,A,N,恰好在这两种操作中产生了相同的结果。

研究团队将完整推理链分解为推理步骤与答案进行深入分析后发现,推理步骤与对应答案之间存在高度一致性。

例如,在组合泛化设置下,推理步骤在测试数据分布f1∘f1到f2∘f2上完全正确,但得出的答案却存在错误。

同样,从f1∘f2泛化到f2∘f1,LLM能够生成正确答案,但这归因于两种正交变换之间的可交换性,而推理路径并不可靠。

表|CoT推理在变换泛化中的不同组件评估。

上述结果表明,CoT推理无法泛化到新的变换,甚至无法泛化到新的组合变换。与其说CoT推理真正理解了文本,不如说它的表现更像是对训练过程中习得模式的简单复刻。

更进一步,研究团队对少量未见数据进行了监督微调(SFT),从而探究CoT推理能否推广至未见过的变换。这种方式能降低训练集与测试集之间的分布差异,这可能有助于LLM对测试查询进行泛化。

图|在不同分布偏移程度下,采用SFT处理未见数据的性能表现。

结果显示,只需要极少量示例样本,就能让模型快速泛化到未见过的变换场景,大幅提升性能。这说明,LLM非常擅长从数据中快速学习新模式,但也说明其能力范围被见过的模式严格限定。

2)元素泛化

当试图将LLM泛化到新任务时,元素泛化是另一个关键因素。

研究团队在固定其他因素后,设置了ID、CMP和OOD三种场景。其中,在ID场景中,测试元素与训练元素使用相同的字母;CMP场景中,测试元素是由训练时接触过的字母构成新的组合;在OOD场景中,测试元素是训练时从未见过的字母。

在组合方面,他们测试了当观察到元素中的所有基本原子时,CoT推理是否能够泛化到新的组合,如(A,B,C,D)→(B,C,D,A)。基于组合中的原子顺序,CMP可以进一步发展。而对于OOD,构成元素的原子在训练期间是完全未见过的。

结果显示,与变换泛化类似,当模型在所有变换中持续遭遇分布偏移时,其性能会急剧下降。从ID到CMP,再到OOD,在所有情况下,精确匹配度均从1.00逐步降至0。

图|不同场景和关系下的元素泛化结果。

他们通过SFT进一步探索CoT推理何时能够泛化到新的元素,如下图。结果显示,当训练数据中出现相似(n较小)的例子时,性能迅速提高。有趣的是,当n=3时,CoT推理的精确匹配率与性能下限一致,这可能表明CoT推理在新颖元素上的泛化能力非常有限,即使在下游任务上进行SFT也是如此。

他们还发现,训练过程中答案与推理步骤之间存在准确性不匹配的问题,这在某种程度上可能解释了为什么在某些情况下CoT推理不一致。

图|SFT在元素泛化方面的性能表现,有助于对新元素进行泛化。

2.长度泛化

长度泛化研究模型在遇到与训练分布长度不同的测试案例时,其CoT推理能力如何退化。

长度差异可能源于文本空间或问题推理空间。因此,研究团队将长度泛化分解为两个互补维度:文本长度泛化与推理步骤泛化。

1)文本长度泛化

文本长度泛化旨在评估当输入文本长度与训练示例不同时,CoT推理的性能如何变化。考虑到LLM处理长文本的方式,这一维度至关重要,因为现实世界的问题通常涉及不同程度的复杂性,这些问题表现为问题陈述长度、上下文大小或信息密度的差异。

研究团队在文本长度为4的数据集上预训练LLM,同时固定其他因素,并在多种长度上评估性能。

实验结果显示,模型仅在文本长度为4的训练数据上表现优秀,精确匹配率达到100%。随着长度差异的增加,CoT推理长度泛化的有效性会降低,精确匹配率也会降至0。这表明LLM对输入长度等统计特性极其敏感。

表|文本长度泛化评估。

他们还探讨了使用不同填充策略减少训练数据和测试案例之间的差异。他们发现,填充到最大长度对长度泛化没有贡献。然而,当他们使用分组(Group)策略用文本替换填充时,性能有所提高。

图|不同填充策略下文本长度泛化的表现。

2)推理步骤泛化

推理步骤泛化旨在研究模型能否外推到与训练时观察到的不同步骤的推理链。这是多步骤推理任务中的常见设置。

与文本长度泛化类似,他们使用推理步骤为2来预训练LLM,并在推理步骤为1或3的数据上进行评估。

结果表明,CoT推理无法在需要不同推理步骤的数据集间泛化,存在泛化失败的现象。随着未见数据比例的增加,目标数据集上的性能呈现提升趋势。与此同时,由于训练数据量不足,语言模型无法对原始训练数据集进行泛化。这说明,模型的性能完全由训练数据的分布构成决定,不存在超越数据分布的泛化。

图|不同训练数据组合下的推理步骤泛化测试性能。

3.格式泛化

格式泛化旨在评估CoT推理对测试查询中表面形式变化的鲁棒性,这一维度对于确定模型是否已经内化了灵活的、可迁移的推理策略,或仍然依赖于训练期间遇到的具体模板和短语尤为重要。

为此,研究团队通过以下四种扰动模式来模拟真实场景:

实验结果表明,CoT推理很容易受到格式变化的影响,无论是插入、删除、修改,还是混合模式,都会产生影响正确性的格式差异。他们进一步将查询内容划分为三个部分:元素、变换和提示词。他们发现,元素和变换在格式中起着关键作用,而其他token的改动对结果影响不大。

图|格式泛化性能表现。

反对质疑

基于以上研究结果,研究团队得出结论:

CoT并非真正的逻辑推理机制,而是一种高级的结构化模式匹配形式,其根本局限在于训练阶段所见的数据分布。一旦略微超出该分布范围,其性能便会显著下降,暴露出其"推理"过程的表面性本质。

而且,他们还在论文中写道,“尽管我们的实验采用了在受控环境中从头开始训练的模型,但所揭示的原理可扩展至大规模预训练模型。”这似乎印证了“CoT看似强大的推理能力本质上是一种脆弱的幻象”的说法。

然而,在国外软件工程师SeanGoedecke看来,这项研究的实验和论证存在一些局限性,并进行了反驳。

“不能单凭这篇论文里的‘小儿科’例子,就对推理模型得出如此宽泛的结论。”

针对这篇论文,他提出了以下观点:

1.推理很可能需要语言的参与

即便是模拟出来的推理,也必须是在人类语言中进行的推理。推理是一项复杂的任务,需要像人类语言这样复杂的工具。推理任务需要在多个不同选项之间做出选择,不断改变方向,但这篇论文里的例子从结构上就不可能做到这一点。

2.模型规模太小制约了结论的普适性

小型模型难以涌现推理能力。一个60万参数的模型,可能可以学会按顺序应用转换规则,但未必聪明到能将这些转换分解成它们各自的组成部分。它没有足够的原始“脑力”来执行相关操作,所以研究结果很难推广到一个10亿、100亿或1000亿参数的模型上。

3.缺少与人类推理的对比

这篇论文的核心论点,推理模型在超出其领域时会遇到困难,这对于强大的人类推理者来说也同样成立。人类推理同样依赖经验模板,在陌生领域容易出错。既然推理模型是在大量人类或类人的推理文本上训练出来的,那么它们的推理方式像人类,又何必惊讶呢?

此外,Goedecke还给出了自己的一些建议——当我们阅读关于模型推理的论文时,需要使用以下启发式方法:

那么,关于“CoT推理并非真正可泛化的逻辑推理”这一说法,你怎么看?